Próbujesz uruchomić najnowsze multimodalne modele AI Gemma3 , ale ciągle otrzymujesz błąd 500 w Ollama WebUI?

Oto rozwiązanie, ale najpierw kilka słów o Gemma 3. Gemma 3 to kolekcja lekkich, otwartych modeli zbudowanych w oparciu o te same badania i technologię, które napędzają modele Gemini 2.0. Modele Gemma 3 są zaprojektowane do szybkiego działania bezpośrednio na urządzeniach i są dostępne w różnych rozmiarach (1B, 4B, 12B i 27B), co pozwala wybrać najlepszy model dla konkretnego sprzętu i potrzeb wydajnościowych.

Modele te są bardzo łatwe do pobrania z biblioteki Ollama i uruchomienia, ale pakiet Ollama Docker Package jest dostarczany z przestarzałą wersją Ollama 0.6.1, więc nie można ich uruchomić bezpośrednio, przynajmniej do czasu aktualizacji pakietu Docker. Pokażę tutaj proste obejście.

Error 500 issue .

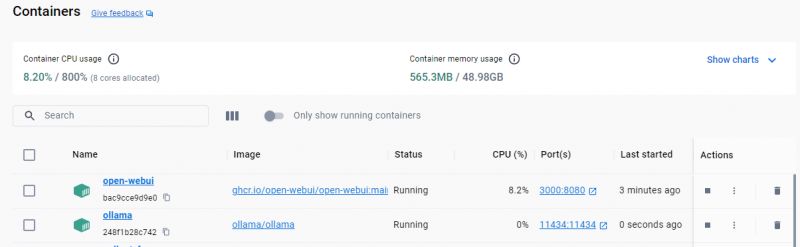

Zakładam więc, że masz już taką konfigurację Dockera:

Ollama core i Ollama Web interface są uruchomione w dockerze.

Jeśli nie, możesz pobrać Ollama WebUI tutaj .

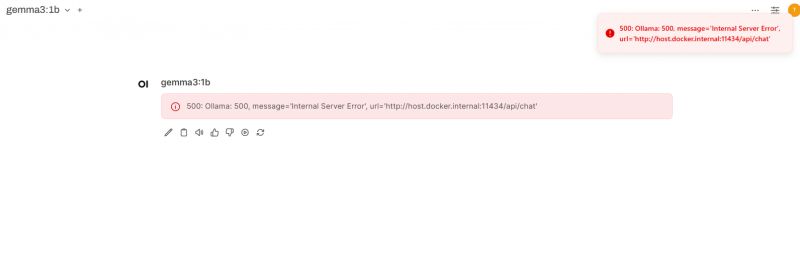

Prawdopodobnie pobrałeś już Gemma3 w interfejsie użytkownika Ollama Web UI, ale gdy spróbujesz go uruchomić, otrzymasz:

500: Ollama: 500, message='Internal Server Error', url='http://host.docker.internal:11434/api/chat'

Tak jak na zrzucie ekranu.

.

.

Przyczyna problemu

Jest to spowodowane tym, że Docker używa przestarzałego rdzenia Ollama, a mianowicie wersji 0.6.1, przynajmniej w moim przypadku. Można to sprawdzić uruchamiając:

C:\Users\user>docker run --rm ghcr.io/open-webui/open-webui:ollama ollama --version

Warning: could not connect to a running Ollama instance

Warning: client version is 0.6.1

Próbowałem ją zaktualizować, ale nie znalazłem sposobu. Na szczęście jest obejście...

Najprostsze rozwiązanie .

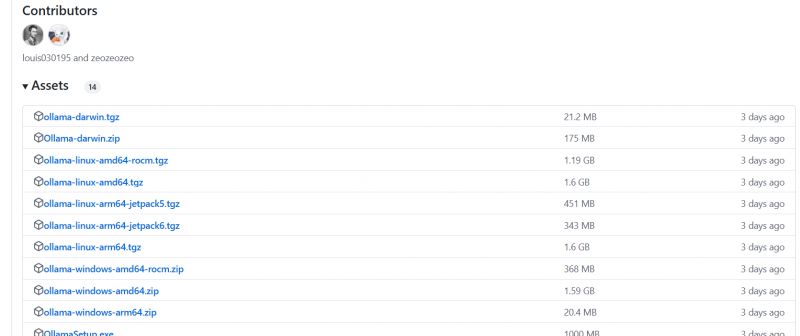

Pobierz Ollamę bezpośrednio z zakładki Wydania:

https://github.com/ollama/ollama/releases/tag/v0.6.2

Wybierz pakiet dla swojego systemu operacyjnego, w moim przypadku był to ollama-windows-amd64.zip.

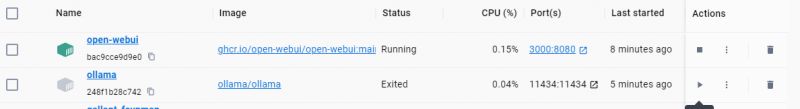

Najpierw zamknij ollamę w Dockerze:

.

.

Wyodrębnij go i uruchom, jak w:

ollama.exe serve

Teraz, o ile ustawienia portów są zgodne, interfejs Ollama WebUI z dockera powinien być w stanie dotrzeć do nowego rdzenia ollama. Możesz również sprawdzić jego wersję:

W:\TOOLS\ollama-windows-amd64>ollama.exe --version

Warning: could not connect to a running Ollama instance

Warning: client version is 0.6.2

Więc teraz używasz nowszej Ollamy. .

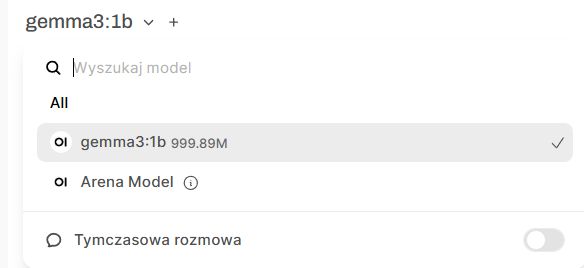

Oznacza to, że będziesz musiał ponownie pobrać modele AI. Do tej pory pobrałem tylko najmniejszą Gemmę.

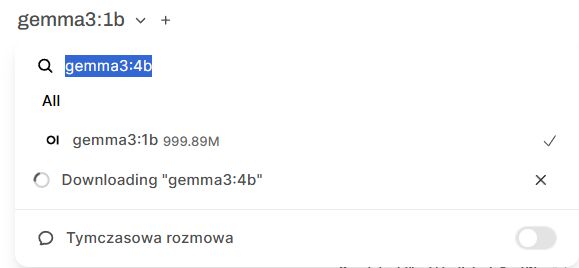

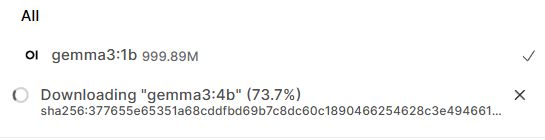

Można też pobrać większy model:

.

.

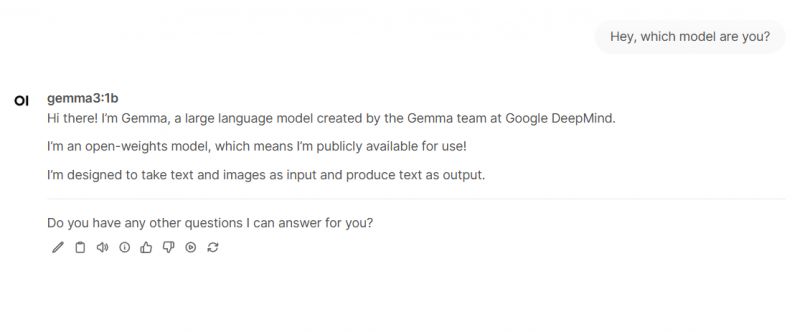

Sprawdźmy czy działa

Teraz słowo ostrzeżenia - najmniejszy model 1b nie działa z obrazami, więc sugeruję zacząć od 4b.

Pierwsze testy Gemmy 3 .

Nadszedł czas na małe testy Gemmy 3. Pobawiłem się z i zdecydowałem się zaprezentować model 27b, ponieważ wydaje się on bardziej niezawodny niż mniejsze. Jednak nadal mogę go uruchomić na moim 7-letnim notebooku do gier ROG.

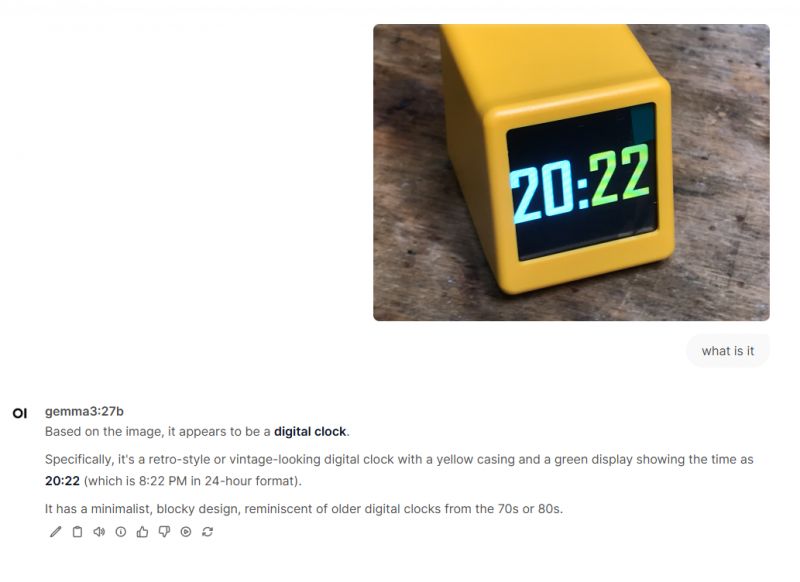

Fajnie, że potrafi poprawnie odczytać godzinę.

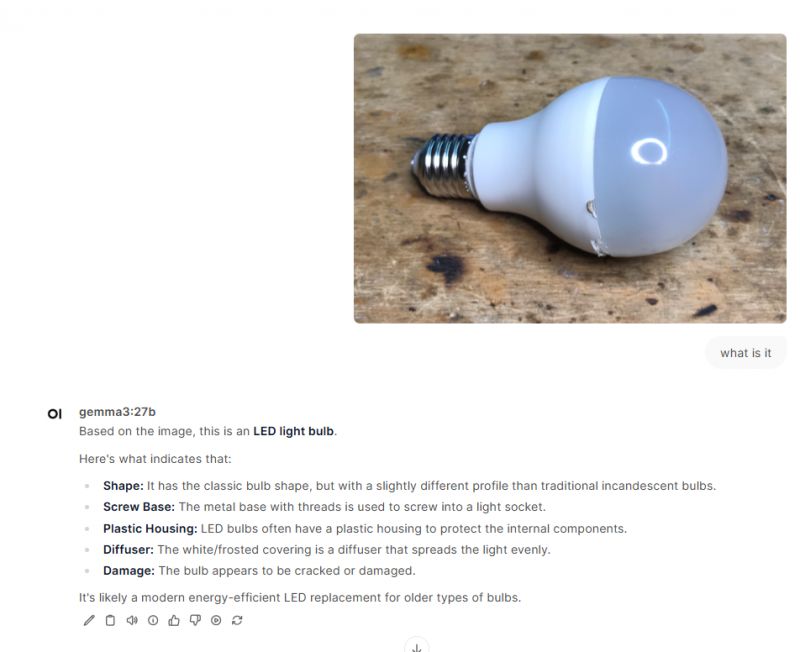

Nieźle, zauważył nawet lekkie uszkodzenie żarówki.

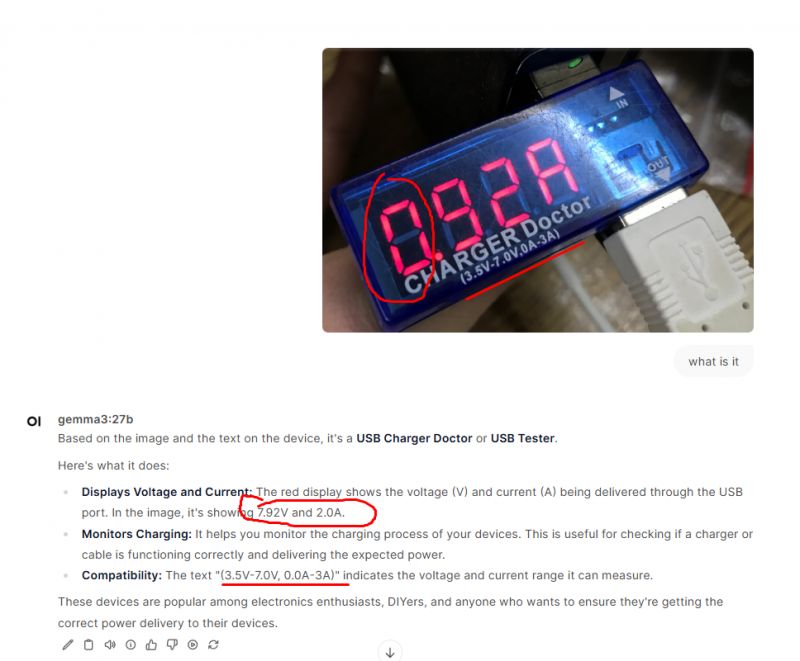

Spróbujmy czegoś trudniejszego.

No cóż, niestety nadal popełnia błędy i może dawać mylące wyniki, ale i tak jest lepiej niż LLaVA którą testowałem w przeszłości....

Podsumowanie .

Okazuje się, że uruchomienie nowych modeli Gemma 3 lokalnie jest bardzo proste. Jedynym problemem jaki napotkałem była przestarzała wersja Ollamy w Dockerze, ale miejmy nadzieję, że pakiet Docker również zostanie wkrótce zaktualizowany, więc nie napotkasz tego problemu w przyszłości.

Jeśli chodzi o samą Gemmę 3, to wydaje się ona bardzo obiecująca, zwłaszcza jej większe wersje. Na pierwszy rzut oka wydają się lepsze niż LLaVa, ale teraz zamierzam przeprowadzić więcej testów.

Zostawię je na inny temat.

Czy próbowałeś również uruchomić Gemma 3, a jeśli tak, to jakie są Twoje doświadczenia?

Jeśli jesteś bardziej zainteresowany Gemmą 3, możesz też po prostu zamieścić tutaj obraz lub podpowiedź, a ja przetestuję z nią Gemmę.

Fajne? Ranking DIY Pomogłem? Kup mi kawę.