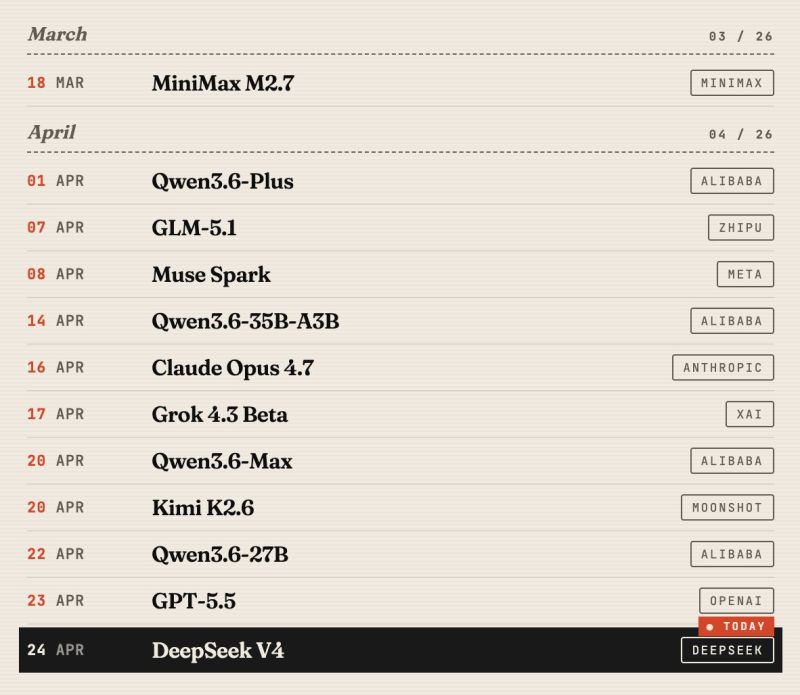

DeepSeek opublikował wersję preview nowej generacji modelu językowego AI DeepSeek‑V4. Premiera odbyła się 24 kwietnia 2026 razem z raportem technicznym i wagami modelu udostępnionymi na Hugging Face. Nowa seria zawiera dwa modele: DeepSeek-V4-Pro ma architekturę Mixture of Experts z 1.6 biliona parametrów całkowitych oraz około 49 miliardów parametrów aktywnych podczas inferencji. Model obsługuje kontekst do 1 miliona tokenów i jest przeznaczony głównie do zadań rozumowania, analizy oraz programowania. Drugi model to DeepSeek-V4-Flash. Posiada 284 miliardy parametrów całkowitych i około 13 miliardów aktywnych. Został zaprojektowany jako tańsza i szybsza wersja do zastosowań produkcyjnych oraz agentów AI. Modele są dostępne przez API DeepSeek, a poprzednie modele chat i reasoner mają zostać wycofane 24 lipca 2026. DeepSeek-V4-Pro-Max osiąga w benchmarkach rezultaty zbliżone doClaude-Opus-4.6-Max, GPT-5.4-xHigh i Gemini-3.1-Pro-High, ale jako jedyny z tych modeli udostępnia do pobrania wagi.

Źródła:

https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro/blob/main/DeepSeek_V4.pdf

https://api-docs.deepseek.com/news/news260424

https://huggingface.co/collections/deepseek-ai/deepseek-v4

Co myślą o tym użytkownicy?

Podsumowanie komentarzy z HackerNews:

- odbiór premiery DeepSeek‑V4 jest dość pozytywny. Komentujący uważają, że to jeden z najmocniejszych modeli z otwartymi wagami i kolejny krok w zmniejszaniu przewagi modeli zamkniętych.

- benchmarki wyglądają dobrze, ale część osób uważa, że model nadal jest trochę za topowymi systemami jak Claude Opus czy Gemini w trudniejszych zadaniach reasoning.

- dużo pozytywnych opinii dotyczy programowania. Według wielu komentarzy model wypada bardzo dobrze w coding tasks i może być bardzo użyteczny dla narzędzi developerskich.

- największe zainteresowanie budzi kontekst 1M tokenów. Część użytkowników zastanawia się, na ile jest to praktyczne w realnych zastosowaniach.

- pojawia się sporo dyskusji o sprzęcie i niezależności technologicznej. Niektórzy komentują, że modele DeepSeek są częścią budowy chińskiego stacku AI niezależnego od Nvidii.

- kilku użytkowników zauważa trend upowszechniania modeli LLM. Różnice jakości zaczynają być mniejsze, więc przewagę mogą dawać raczej narzędzia, workflow i integracje niż sam model.

Czy DeepSeek 4 znajdzie swoje miejsce pośród zamkniętych modeli? Zapraszam do dyskusji.

Źródła:

https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro/blob/main/DeepSeek_V4.pdf

https://api-docs.deepseek.com/news/news260424

https://huggingface.co/collections/deepseek-ai/deepseek-v4

Co myślą o tym użytkownicy?

Podsumowanie komentarzy z HackerNews:

- odbiór premiery DeepSeek‑V4 jest dość pozytywny. Komentujący uważają, że to jeden z najmocniejszych modeli z otwartymi wagami i kolejny krok w zmniejszaniu przewagi modeli zamkniętych.

- benchmarki wyglądają dobrze, ale część osób uważa, że model nadal jest trochę za topowymi systemami jak Claude Opus czy Gemini w trudniejszych zadaniach reasoning.

- dużo pozytywnych opinii dotyczy programowania. Według wielu komentarzy model wypada bardzo dobrze w coding tasks i może być bardzo użyteczny dla narzędzi developerskich.

- największe zainteresowanie budzi kontekst 1M tokenów. Część użytkowników zastanawia się, na ile jest to praktyczne w realnych zastosowaniach.

- pojawia się sporo dyskusji o sprzęcie i niezależności technologicznej. Niektórzy komentują, że modele DeepSeek są częścią budowy chińskiego stacku AI niezależnego od Nvidii.

- kilku użytkowników zauważa trend upowszechniania modeli LLM. Różnice jakości zaczynają być mniejsze, więc przewagę mogą dawać raczej narzędzia, workflow i integracje niż sam model.

Czy DeepSeek 4 znajdzie swoje miejsce pośród zamkniętych modeli? Zapraszam do dyskusji.

Fajne? Ranking DIY Pomogłem? Kup mi kawę.